Quảng Cáo

0943778078

Tỷ phú đồng sáng lập Fox Broadcasting nhận định rủi ro lớn nhất của AI không nằm ở các CEO, mà ở những hậu quả bất ngờ mà ngay cả người tạo ra chúng cũng không lường trước.

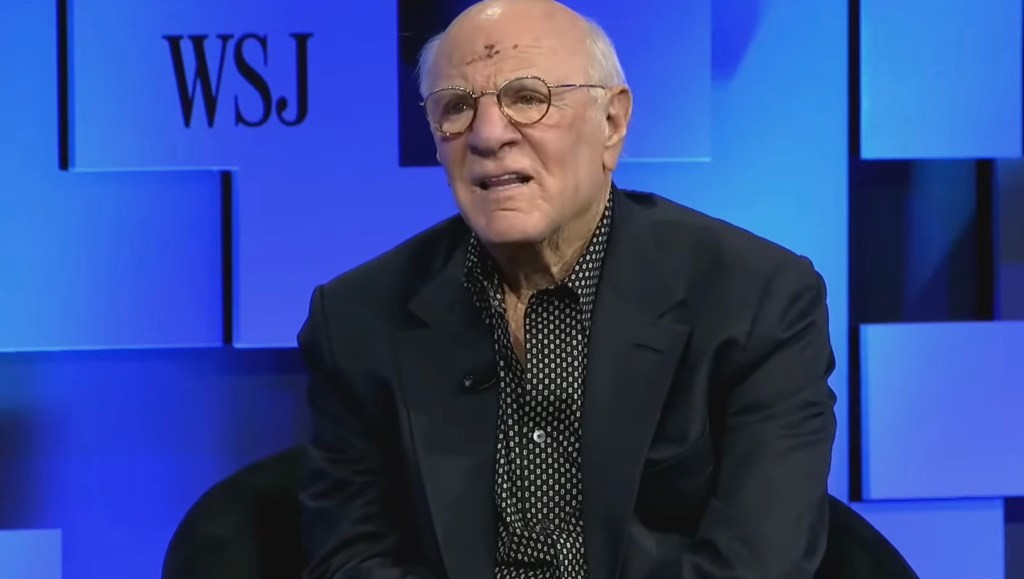

Tỷ phú truyền thông Barry Diller, đồng sáng lập Fox Broadcasting và chủ tịch của IAC lẫn Expedia Group, đã lên tiếng bảo vệ Sam Altman, CEO của OpenAI, tại hội nghị "Future of Everything" do tờ Wall Street Journal tổ chức tuần này. Ông khẳng định Altman là người chân thành và có phẩm chất đạo đức tốt, bất chấp những cáo buộc trước đây từ một số cựu đồng nghiệp và thành viên hội đồng quản trị rằng ông Altman có thái độ thao túng và thiếu trung thực.

Diller, người quen biết với Altman, được hỏi rằng liệu mọi người có nên đặt niềm tin vào CEO OpenAI để đảm bảo AI mang lại lợi ích cho nhân loại. Câu trả lời của ông đặt vấn đề niềm tin vào một góc độ khác hẳn: điều đáng lo ngại không phải là bản thân những người đang dẫn dắt lĩnh vực này, mà là những hậu quả không ai lường trước được từ chính công nghệ đó.

"Một trong những vấn đề lớn với AI là nó vượt xa câu chuyện niềm tin. Có thể niềm tin không còn liên quan nữa, bởi những gì đang xảy ra là điều bất ngờ ngay cả với những người đang tạo ra chúng. Tôi đã dành nhiều thời gian với những người đang trong giai đoạn sáng tạo AI, và chính họ cũng cảm thấy kinh ngạc. Đây là điều chưa ai biết. Chúng ta không biết. Họ cũng không biết", Diller giải thích.

Diller cũng nhận xét về làn sóng đầu tư vào ngành này. Ông nói thẳng: "Chúng ta đã bước vào thứ gì đó sẽ thay đổi gần như mọi thứ. Điều này không hề bị xem nhẹ. Còn liệu những khoản đầu tư khổng lồ này có thành quả hay không, tôi chẳng quan tâm. Tôi không rót tiền vào đó, nhưng tiến bộ vẫn sẽ được tạo ra."

Dù vậy, ông nhấn mạnh rằng phần lớn những người đang dẫn đầu cuộc chơi AI đều là những người quản lý có trách nhiệm. Riêng với Altman, Diller tin ông là "người tốt với các giá trị đúng đắn". Tuy nhiên, ông từ chối nêu tên ai trong số các lãnh đạo AI mà ông cho là không chân thành.

Nguy cơ lớn nhất: trí tuệ nhân tạo tổng quát không có kiểm soát

Phần đáng chú ý nhất trong phát biểu của Diller xoay quanh AGI, dạng trí tuệ nhân tạo lý thuyết có khả năng vượt trội hơn con người ở mọi lĩnh vực. Ông cho rằng nhân loại đang tiến gần đến ngưỡng đó với tốc độ ngày càng nhanh, nhưng chưa có ai thực sự hiểu điều gì sẽ xảy ra khi đạt đến đó.

"Họ không biết điều gì có thể xảy ra khi AGI thực sự xuất hiện, và chúng ta đang tiến gần đến đó. Chưa đến nơi, nhưng ngày càng gần hơn, nhanh hơn. Và chúng ta phải nghĩ đến các biện pháp kiểm soát", Diller cảnh báo.

Ông nhấn mạnh rằng nếu con người không chủ động thiết lập các biện pháp kiểm soát, thì một thực thể AGI sẽ tự làm điều đó thay, và khi đó, mọi thứ sẽ không thể đảo ngược. "Một khi bạn giải phóng nó ra, sẽ không có đường quay lại", ông nói.

1 hour ago

1

1 hour ago

1